Emploi et digitalisation

Par Bruno Schröder*, Directeur technologique chez Microsoft Belux

* Bruno Schröder est directeur technologique chez Microsoft pour la Belgique et le Luxembourg. Il est président du CETIC, centre de recherche appliquée en informatique. Il est fondateur du Microsoft Innovation Center (MIC) à Mons

L’emploi et la digitalisation est un sujet bien vaste, soulevant des questions aussi bien économiques, sociales que technologiques. Ces dernières années, l’impact de la transformation digitale sur l’emploi, sur la formation, mais aussi sur notre mode de vie se fait de plus en plus ressentir. En 2016, ING avait licencié 3 158 travailleurs suite à l’augmentation des interactions digitales et au manque d’experts dans les métiers digitaux. Même année, l’affaire Cambridge Analatyca a déclenché un scandale en exploitant des données personnelles digitales. Sujet majeur des débats, la digitalisation soulève bien de nouvelles questions. Quels sont les emplois de demain ? Quels sont ces nouvelles compétences « numériques » ? Quels politiques de protection des données ? Quels sont les impacts sur la socialisation des adolescents ? etc.

En spécialiste du sujet, Bruno Schröder est venu nous présenter son expertise ainsi que son interprétation personnelle. Son rôle, chez Microsoft, est d’essayer de comprendre et d’anticiper les impacts que la technologie aura dans les cinq ou dix prochaines années. L’anticipation sur une longue durée correspond, nous dit-il, au décalage entre le moment où une technologie est créée dans les laboratoires et le moment où elle est effectivement mise sur le marché public. Pour les experts, l’impact de la transformation digitale sur l’emploi, sur la formation et sur tous les autres aspects était évident en 2006. C’est pourquoi, ce besoin d’anticiper est nécessaire dans la manière dont il faut se préparer et éviter les difficultés telles que celles que les entreprises ont connues récemment.

L’intelligence artificielle, un enjeu fondamental

À l’heure actuelle, l’emploi et la digitalisation portent particulièrement leur attention sur l’automatisation normale des processus, c’est-à-dire l’automatisation des tâches et des actions par l’usage de machines, de robots et d’algorithmes. Beaucoup de choses ont déjà été dites à ce sujet. Pourtant, B. Schröder souligne que l’enjeu fondamental se situe au sein d’une technologie très populaire mais peu comprise : l’intelligence artificielle. L’IA est une technologie qui reste, à ce stade, très mal décrite par la presse et les autres médias. Pour comprendre une telle technologie, il faudra dépasser toutes ces définitions populaires que B. Schröder appelle « hyperbole marketing ». L’IA sera amenée à supplanter les technologies actuelles et à revoir l’emploi autant dans son approche que dans sa pratique. Son impact sera fondamental dans les années à venir. Voici quelques explications et pistes fondamentales.

L’évolution de la puissance de calcul des ordinateurs

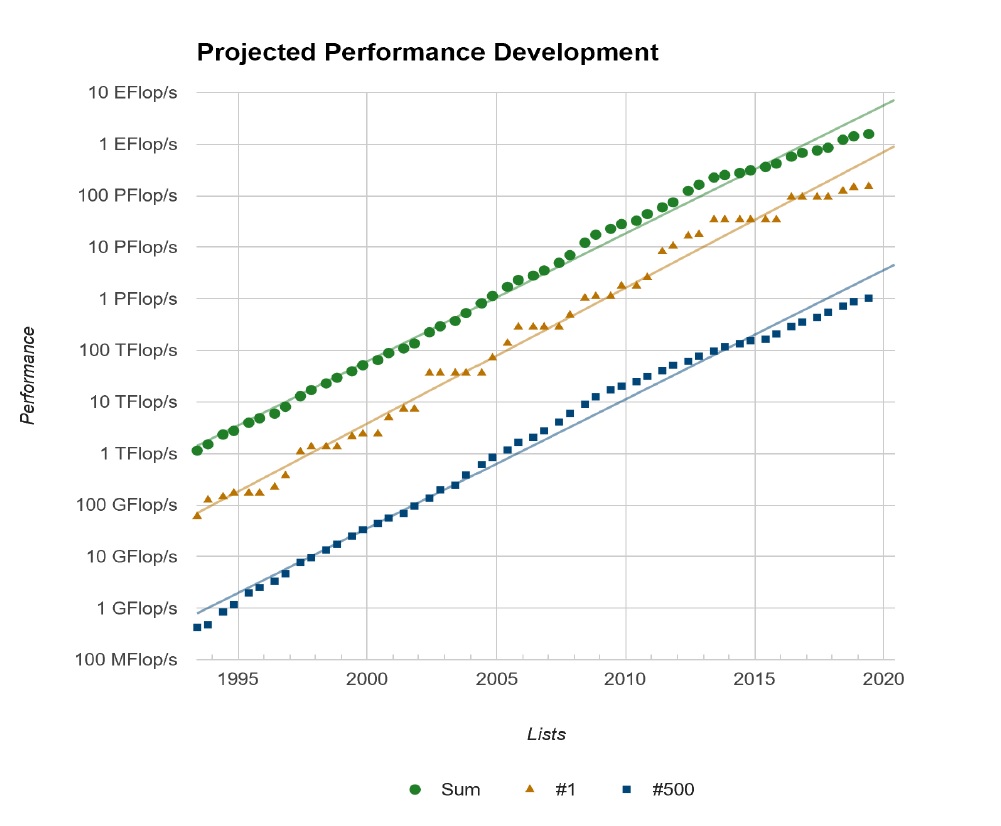

Pour expliquer ce qui fait « le moteur » de cette technologie, B. Schröder nous invite à comprendre la courbe d’évolution de la puissance de l’ordinateur #1, c’est-à-dire le plus performant.

Courbe de l'évolution de la puissance de l'ordinateur numéro 1

Cette courbe suit ce que les scientifiques appellent « la loi de Moore » et décrit qu’en augmentant l’efficacité de l’électronique, la puissance de calcul des ordinateurs augmente au cours du temps. La loi de Moore soutient que la puissance de calcul double tous les 18 mois. Cela signifie qu’en 10 ans, un ordinateur est 100 fois plus puissant. Si Moore prévoit une telle évolution, elle est avant tout une observation et la réalité nous montre que sur 10 ans, l’ordinateur est devenu 1 000 fois plus puissant. B. Schröder ajoute que, ces dernières années, avec le cloud, c’est-à-dire de l’informatique tournant dans de grands datacenters à l’échelle de la planète, nous arrivons à une capacité à peu près 8 000 fois plus puissante tous les 10 ans. Enfin, avec l’arrivée des ordinateurs quantiques, le bon sera de l’ordre du million en puissance. En réalité, selon notre interlocuteur, depuis les années 80-90, les entreprises disposaient déjà de toute la puissance nécessaire pour les grands processus industriels. Actuellement, les experts travaillent plutôt sur l’amélioration de l’interface. C’est ainsi que nous sommes capables de parler à des ordinateurs qui arrivent à comprendre la parole. Et c’est ce que la presse appelle « l’intelligence artificielle ».

La métaphore culturelle de l’intelligence artificielle

« L’intelligence artificielle, c’est une métaphore culturelle qui ne décrit pas la technologie qu’elle veut représenter. »

Telle qu’elle est présentée dans les médias, l’IA ne décrit pas la technologie qu’elle veut représenter. Ok Google, Siri ou Alexa sont ces interfaces capables de comprendre ce que nous leur disons, de donner la météo ou de prendre des rendez-vous. Selon B. Schröder, ceci est une métaphore culturelle basée sur des concepts qui n’ont aucun lien avec la technologie derrière. L’intelligence artificielle se définit plutôt comme un nouveau modèle d’interprétation des données extrêmement sophistiqué par rapport à ce qui se faisait dans le passé. C’est une « nouvelle méthode de prédiction ou de détection d’informations dans des longues séries temporelles ou d’échantillon à base de modèle probabiliste extrêmement sophistiqué ». En d’autres termes, l’IA, c’est simplement des statistiques et de la probabilité avec 8 000 fois plus de puissance de calcul.

Dès lors une question se pose à partir de cette métaphore : est-ce que l’IA doit être éthique en terme technologique ? Selon B. Schröder, c’est parce que derrière l’IA, il y a de l’intelligence et donc il faut de la morale. Pour notre expert, c’est une erreur de langage qui aborde faussement le problème et met l’accent sur des domaines qui ne sont pas les bons. Dans des métiers tels que ceux de l’insertion socioprofessionnelle, cette interprétation va mener à « des voies de garage ». La question de l’IA se pose comme pour n’importe quel outil ; c’est-à-dire qu’elle renvoie à son utilisation. Il s’agit plutôt, pour B. Schröder, de parler d’une éthique de l’utilisation plutôt qu’une éthique de la technologie.

Le cloud et la massification industrielle

Ces dernières années, avec l’augmentation de la puissance de calcul, nous avons pu construire de nouvelles infrastructures informatiques : le cloud. Ce système ultra sophistiqué permet à une moitié de la population de posséder dans sa poche des petits ordinateurs extrêmement puissants. En terme industriel, le cloud permet de construire des mini-calculateurs suffisamment puissants et extrêmement limités en taille. Désormais, les ingénieurs sont capables de créer des micro-puces et des micros-capteurs qui peuvent mesurer toute une série de paramètres (température, humidité, pression atmosphérique, etc.) et qui envoient une série de données par wifi, Bluetooth ou un autre protocole. Des modèles sont alors utilisés pour analyser ses grandes quantités de données. C’est ce que nous appelons l’internet des objets.

Pour B. Schröder, nous sommes capables maintenant d’aller chercher dans d’énormes quantités de données toute une série de corrélation entre une série de paramètres. C’est là où il situe l’innovation fondamentale, c’est une nouvelle manière de résoudre les problèmes. C’est ce que les spécialistes appelle le « quatrième paradigme », l’analyse statistique et d’échantillon, et de séries temporelles.

Les ordinateurs ont permis de massifier la résolution de systèmes très compliqués. Combiné à l’IA, le cloud a permis de massifier tout ce qui se fait autour de la mesure et de l’échantillonnage. C’est une toute nouvelle manière de résoudre des classes de problèmes par les données mais de manière industrielle. À présent, selon B. Schröder, n’importe qui est capable de déployer ces données. Elles sont implémentables par à peu près tout le monde et à des coûts moindres, ce qui la technologie beaucoup plus accessible en plus d’être plus efficace.

Quelle influence sur l’emploi ?

Les problèmes que nous pouvons résoudre sont des problèmes non modélisables que l’on peut traiter par échantillonnage et par des données dans des séries temporelles données. Pour B. Schröder, dans un domaine où il n’est pas possible de prendre des mesures et où il n’y a pas de capacité d’avoir de grand échantillons, l’influence de l’IA et de la nouvelle vague de l’automatisation seront nuls. Dans des domaines où il y a de l’interaction physique et où l’empathie et la compassion jouent un rôle important, l’IA ne fonctionnera pas. Des métiers tels que les dentistes, les plombiers et les coiffeurs sont, par exemple, des professions totalement protégées. Le concept ne peut pas être adapté à ce type de métier.

L’exemple du juge automatique montre que cela peut fonctionner pour un droit extrêmement formalisé, comme le droit du travail. Par contre, l’IA ne dispose pas assez de données pour fonctionner là où un juge peut faire preuve de compassion ou d’empathie pour l’une ou l’autre partie. Pour la justice pénale, il faudra peut-être 200 ans ou 300 ans pour avoir suffisamment de cas et commencer à tirer des séries et des comparaisons. Ainsi, les points critiques de cette technologie sont la mesurabilité et l’extraction de suffisamment de données.

Les avancées du moment : la massification des services

En 2016, l’IA a obtenu une parité avec des êtres humains pour décrire ce qu’il y a dans une image dans un flux vidéo grâce au Deep Learning ; modèle où la machine est capable d’apprendre par elle‑même en s’appuyant sur un réseau de neurones artificiels. Aujourd’hui, le Deep learning peut interpréter 300 couches de neurones, ce qui permet de trouver des choses extrêmement précises. En 2017, l’IA permet de reconnaitre ce que les gens disent. B. Schröder précise que cela ne fonctionne que pour certains cas. Il souligne que le système n’arrive pas encore à comprendre mais qu’il peut, par contre, retranscrire. Selon lui, nous ne sommes pas encore arrivés à une généralisation des chatbot, logiciel programmé pour simuler une conversation en langage naturel, car la profondeur des conversations est encore trop réduite.

Au niveau de la traduction, l’IA est également à une parité. En effet, le problème de la traduction ne se résout pas en implémentant un modèle, c’est-à-dire avec des règles de traduction, mais en se servant de la traduction statistique. L’IA permet d’échantillonner des traductions déjà existantes et de vérifier la correspondance d’une phrase à traduire avec celles déjà disponibles dans un corpus. Les règles de grammaire sont ensuite appliquées. Selon B. Schröder, le système de traduction s’améliore de jour en jour car, en augmentant la taille du corpus, la qualité de la traduction augmente. La taille d’un corpus explique pourquoi l’IA fonctionne avec certaines langues et pas d’autres. En Belgique, par exemple, le néerlandais dispose d’une taille d’échantillon plus faible que la moyenne, ce qui rend la traduction moins efficace.

Ces différentes applications de l’intelligence artificielle montrent qu’elles arriveront d’une manière ou d’une autre dans toutes les séries de l’emploi, là où il y a une interaction avec le monde extérieur. Ces types d’interactions sont digitalisables car elles sont mesurables, ce qui n’est pas le cas pour des interactions physiques. Pour arriver à mettre cela au point, il faut aller chercher le signal dans les informations, des données de sources complètement différentes qui permettront d’avoir des variables. Pour B. Schröder, c’est le paradigme du « est-ce que je peux mesurer le phénomène », c’est le quatrième paradigme. Pour lui, si l’IA va avoir une influence sur tout une série d’emplois dans le secteur des services c’est parce qu’il y a des choses qui sont potentiellement possibles et mesurables.

Les limites de l’IA

La puissance de l’intelligence artificielle, c’est sa capacité à détecter des corrélations statistiques dans des informations. L’approche statistique, contrairement au modèle mathématique, est moins fiable. Cela signifie qu’il y a une probabilité pour que la réponse soit bonne. Par exemple, si la probabilité est de 99 %, 1 % sera alors fausse. B. Schröder souligne qu’il s’agit d’un élément à ne pas oublier. Il ajoute que « l’intelligence artificielle peut se tromper et va se tromper ». Son taux d’erreurs dépend de sa fiabilité.

« Si vous remplacez les humains, ça ne marche pas. Ça va conduire à des catastrophes. »

Attribuer un service IA à des personnes implique qu’elles doivent être capables de détecter des erreurs quand la machine se trompe et de pouvoir les résoudre. Pour notre interlocuteur, remplacer complètement les humains ne fonctionnera donc pas et risque de conduire à des drames sociaux. Pour lui, ces types de décision peuvent avoir un effet extrêmement important sur l’emploi. C’est pourquoi, l’élément fondamental se situe dans la différence entre le probable et le possible. L’intelligence artificielle donne la probabilité du passé mais elle est incapable d’anticiper les changements futurs. Pour les processus industriels, cela a moins d’importance mais, dès qu’il s’agit de services et dès que ceux-ci s’adressent à des humains, cela a une importance fondamentale.

Ensuite, une autre limite est la dérive du système. L’intelligence artificielle n’est pas stable car les conditions changent. Elle se modifie en fonction des données qu’elle reçoit, c’est pour cela que nous parlons d’intelligence. C’est pourquoi, selon notre interlocuteur, ce système peut dériver et parfois de manière extrêmement spectaculaire. Microsoft avait mis au point plusieurs chatbot sur Twitter afin de comprendre comment construire une personnalité digitale à travers des interactions. Un de ces chatbot a été repéré par des adolescents qui l’ont alimenté en commentaires racistes et misogynes. En 24 heures, la personnalité digitale était devenue une personnalité épouvantable sur le web et a dû être fermé au bout de 24 heures.

« L’utilisation de l’IA, c’est l’assistance à l’humain. Il faut que l’humain reste dedans. »

Au niveau industriel, en ce qui concerne les processus industriels ainsi que le pilotage de machine, le problème se pose moins. Mais dans les entreprises, il est essentiel d’avoir une personne capable de comprendre les méthodes pour pouvoir repérer et gérer le dérapage et d’éviter des erreurs et des catastrophes engendrés par l’IA. C’est l’humain qui est capable de mettre en évidence les changements récents, les interactions et les non-mesurables (l’empathie et la compassion). Le problème se situe donc au niveau des contraintes de la méthode. Si l’usager ne comprend pas la méthode d’échantillonnage et l’interprétation statistique probabiliste, il sera incapable de gérer la dérive du système. De ce fait, l’utilisation de l’IA, c’est d’abord l’assistance à l’humain. Il faut que l’humain reste dedans. S’il n’est pas dans la boucle, la technologie ne fonctionnera pas.

B. Schröder recommande d’augmenter l’intelligence humaine et non de la remplacer. Il plaide également pour le contrat social car l’approche probabiliste est un choix de société et non une optimisation technologique. Il faut comprendre que l’intelligence artificielle pousse à une société du probable et que l’ensemble de la population comprenne quelles sont les implications de ce genre de technologie. Le contrat social consiste à mettre les personnes qui sont la cible du service dans l’évaluation permanente de ces mêmes services. Le point clé se trouve dans l’éthique de l’utilisation et ne se situe pas dans celle de la technologie.

Des nouvelles compétences et quelques pistes

Il existe toute une série d’éléments qui peuvent se déduire de l’IA. Le premier concerne les compétences fondamentales à développer. B. Schröder plaide depuis très longtemps pour développer la pensée algorithmique et non la programmation. Il faut d’abord pouvoir utiliser cet outil. Un exemple pour développer la pensée algorithmique est de jouer à Mastermind. Pour notre interlocuteur, un bon joueur de Mastermind sera capable de comprendre ce qu’est la pensée algorithmique. Cela peut se faire très tôt avec les enfants.

Un autre élément à développer est la compréhension probabiliste, c’est-à-dire comprendre un modèle d’échantillonnage et son modèle d’interprétation. Un exemple pour développer cette compétence est d’organiser dans des écoles des élections de délégués de classe et d’y appliquer ensuite un modèle français d’interprétation des résultats électoraux et un modèle américain. Un autre exemple est de faire échantillonner le nombre de plantes différentes ou d’animaux présents dans une prairie. Ces exemples sont des expériences faciles à mettre en œuvre lors de l’apprentissage. B. Schröder souligne qu’il n’est pas nécessaire de développer de grands cours mais qu’il faut plutôt familiariser le monde aux concepts probabilistes, aux différents choix de modèles.

Le troisième élément est la collaboration digitale-être humain. Dans un monde digital, tout est collaboration. Contrairement à ce qui est dit, le digital n’isole pas. Dans l’enseignement, par exemple, une des choses les plus contre-productif est le travail de groupe. Pour notre interlocuteur, il s’agit d’une erreur fondamentale d’isoler la contribution individuelle et d’en donner une cote personnelle. Selon lui, le meilleur moyen de renforcer l’esprit de collaboration est d’induire un sens de partage du risque qui sera nécessaire dans les entreprises ultérieurement. C’est pour cela qu’il recommande que les enfants écrivent et réalisent une pièce de théâtre eux-mêmes ou fassent de la musique ensemble. C’est dans ces environnements-là que l’enfant va apprendre à partager le risque global. C’est ainsi qu’il apprend à construire un modèle des interactions que nous pourrons avoir.

Enfin, les jeux vidéo sont également une plateforme d’entrainement extrêmement importante pour le monde digital. Dans un jeu, il n’y a pas de mode d’emploi et le joueur doit comprendre comment cela fonctionne, doit se construire son heuristique de fonctionnement et définir, comparer et ensuite trouver ainsi des stratégies qui vont lui permettre de faire face au monde virtuel. C’est donc ainsi que nous pouvons vraiment arriver à une diversité des interprétations, à une ouverture d’esprit aux outils numériques.

20% de la population ne comprend pas le digital. Les compétences numériques deviennent des compétences de base. L’importance du « contrat social » est d’intégrer les personnes éloignées de l’emploi dans la mise en place du digital. Pour ce faire, cela doit se trouver dans la loi.